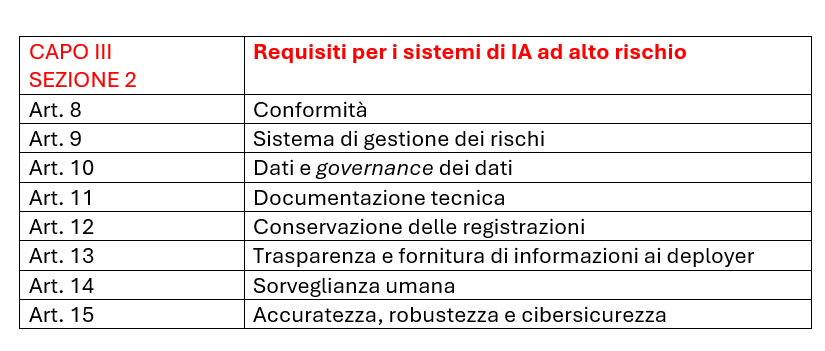

#5_ AI ACT: i requisiti dei sistemi di IA ad alto rischio

Gli articoli 8-15 dell'AI ACT si occupano dei requisiti che devono soddisfare i sistemi di intelligenza artificiale ad alto rischio. Vediamo quali sono e quali attività richiedono.

Eccoci con un nuovo appuntamento con LISP.

Innanzitutto, un benvenuto ai nuovi iscritti che in queste settimane si sono uniti alla newsletter!

Domani sarò a Bologna per il We Make Future 2024.

Sono molto felice di partecipare a questa edizione come speaker. Per chi parteciperà e vuole passare, il mio intervento “Come ottenere il copyright sui lavori creati con l’intelligenza artificiale” è previsto per le ore 18:00 nello Stage Legal Tech.

Ma adesso continuiamo con la nostra analisi dell’AI ACT concentrandoci sui requisiti dei sistemi di IA ad alto rischio.

I requisiti dei sistemi di IA ad alto rischio

Gli articoli 8-15 del Regolamento europeo sull’intelligenza artificiale si occupano dei requisiti che devono soddisfare i sistemi di intelligenza ad alto rischio, di cui abbiamo parlato nel precedente articolo.

Il primo requisito che devono soddisfare riguarda l’adozione di un Sistema di gestione dei rischi.

Il Sistema di gestione dei rischi

Il sistema di gestione dei rischi è un processo che deve essere implementato e mantenuto attivo costantemente durante tutto il ciclo di vita del sistema di intelligenza artificiale, con un riesame costante e un aggiornamento delle procedure.

Esso prevede una prima fase di analisi del sistema e delle sue implicazioni, dopo la quale si possono identificare i rischi prevedibili derivanti dall’uso di quel sistema, per la salute, la sicurezza e per i diritti fondamentali delle persone.

In particolare si dovranno considerare i rischi derivanti dall’utilizzo del sistema per le sue finalità e dalla raccolta dei dati nel corso del suo utilizzo.

Una volta identificati i rischi, occorre procedere a individuare e adottare le misure di gestione, e riduzione, del rischio più adeguate al caso concreto.

Nel valutare le misure per eliminare o ridurre i rischi si devono tenere in considerazione le conoscenze tecniche, l'esperienza, l'istruzione e la formazione che ci si può aspettare dall’utilizzatore a cui è desinato il sistema.

I sistemi di gestione ad alto rischio sono anche sottoposti a una prova per individuare le misure di gestione dei rischi più appropriate.

Governance dei dati

Altro requisito richiesto per i sistemi ad altro rischio è la Governance dei dati.

Ciò significa che i set di dati di addestramento, convalida e prova devono essere pertinenti, sufficientemente rappresentativi e, per quanto possibile, esenti da errori e completi. Devono, in sostanza, avere le proprietà statistiche appropriate.

Devono essere implementate procedure per la loro raccolta, per il loro controllo e aggiornamento e devono essere rispettate anche le altre normative, in particolarmente il GDPR per quanto riguarda il trattamento di dati personali.

Documentazione tecnica e registrazione dei log

I sistemi ad alto rischio devono dotarsi di una specifica Documentazione tecnica, redatta accuratamente per dimostrare, in caso di controllo, di avere soddisfatto tutti i requisiti previsti nell’AI Act e in particolare in questa sezione.

Altro requisito richiesto è la Registrazione dei log. I sistemi ad alto rischio devono registrare e conservare tutti gli eventi che si realizzano nel corso del ciclo di vita del sistema, per la tracciabilità del suo funzionamento e l’individuazione di situazioni che possono determinare un rischio.

Trasparenza

I sistemi devono poi avere Trasparenza, ovvero consentire all’utilizzatore di comprenderne il funzionamento in modo semplice e chiaro, in modo che possa essere in grado di stabilire il tipo di utilizzo che possa fare dell’output generato.

Per questo devono essere sempre corredati da specifiche Istruzioni che devono contenere, oltre al nome del fornitore, anche le caratteristiche essenziali del sistema e in particolare il livello di accuratezza, di robustezza e di cibersicurezza, le circostanze che possano comportare rischi per la salute e la sicurezza o per i diritti fondamentali, le specifiche dei dati di input o sul set di dati di addestramento, convalida e prova, le misure di sorveglianza umana, le risorse computazionali e di hardware necessarie.

Sorveglianza umana

I sistemi ad alto rischio devono essere, inoltre, progettati e sviluppati in modo tale da poter avere una Supervisione umana, da parte di persone fisiche durante il periodo in cui sono in uso. La sorveglianza umana è ritenuta essenziale per prevenire o ridurre al minimo i rischi per la salute, la sicurezza o i diritti fondamentali che possono emergere durante l’uso.

L’intervento umano è proporzionato alla gravità del rischio connesso all’uso del sistema.

Le persone fisiche che supervisionano devono essere in grado di potere comprendere le caratteristiche e i limiti del sistema per individuare determinate anomalie, interpretare gli output, decidere di non usare il sistema in determinate condizione, avere il potere di arrestarlo.

Per alcuni tipi di sistemi ad alto rischio è previsto anche che il sistema deve essere strutturato in modo che l’utilizzatore non assuma decisioni sulla base di una sua identificazione, a meno che quest’ultima non sia stata verificata da almeno due persone fisiche.

Accuratezza, robustezza e cibersicurezza

Infine, i sistemi da alto rischio devono essere progettati e sviluppati in modo tale da conseguire un adeguato livello di Accuratezza, robustezza e cibersicurezza durante tutto il loro ciclo di vita, in quanto devono essere resilienti ai tentativi di terzi non autorizzati di modificarne l'uso, gli output o le prestazioni.

Grazie per aver letto LISP!

La rubrica LISP_AI Act analizza tutti gli aspetti del nuovo Regolamento dando indicazioni pratiche per la sua applicazione da parte delle aziende.

Hai domande su questo nuovo Regolamento? Scrivimi cliccando sul bottone qui sotto.

LISP_AI Act: le puntate precedenti

AI Act - Modelli organizzativi e case studies per avvocati e imprese | Corso Online

Il 19 giugno 2024 parliamo di AI ACT nel corso online in diretta organizzato da Formazione Maggioli, che terrò insieme all’avvocato Andrea Sirotti Gaudenzi.

Sarà un’occasione per approfondire le applicazioni pratiche, le singole fasi e attività che gli adeguamenti al Regolamento europeo AI Act richiederanno alle imprese e ai professionisti coinvolti nei processi entro il prossimo biennio.

Io terrò la prima parte del corso sulle misure organizzative e i modelli operativi da mettere in atto per adeguarsi all’AI ACT, dalla Due Diligence al Risk Assessment.

Per il programma completo e per iscriversi, visitare il sito di Formazione Maggioli.