La proposta di legge sull’AI del Brasile

La proposta di legge sull'intelligenza artificiale del Brasile rappresenta una delle prime normative latinoamericane volte a regolamentare l’AI in modo organico.

La proposta di legge n. 2338/2023 “Dispõe sobre o uso da Inteligência Artificial” rappresenta una delle prime normative latinoamericane volte a regolamentare l’AI in modo organico, con il fine di promuovere l’uso responsabile delle nuove tecnologie, proteggendo al tempo stesso i diritti fondamentali dell’uomo e garantendo che l’adozione di sistemi di intelligenza artificiale avvenga in maniera sicura e trasparente.

I problemi affrontati dalla normativa sono gli stessi che sono alla base di altre proposte di legge, ma in questo caso sembra che il governo brasiliano voglia attuare i suoi propositi regolatori quanto prima ed abbia già posto le base per una attuazione efficace.

Le tutele previste

La proposta di legge stabilisce una serie di diritti per gli utenti, conformandosi a standard etici e giuridici internazionali. Tra i diritti principali richiamati vi sono:

Il diritto all’informazione preventiva, in base al quale coloro che utilizzano sistemi di intelligenza artificiale devono essere informati preventivamente quando interagiscono con sistemi di AI, non solo per questioni di trasparenza, ma soprattutto per consentire un’interazione consapevole, in conformità al principio di autodeterminazione.

Il diritto alla disclosure. La decisione presa da un sistema di AI deve essere comprensibile e giustificabile. L’utilizzatore deve essere messo nella condizione di comprendere il processo decisionale che ha condotto ad un certo risultato, ma anche l‘effetto impattante che può avere nella sua vita reale affidarsi all’output offerto da un sistema AI.

Il diritto alla contestazione. È previsto il diritto di contestare le decisioni algoritmiche che abbiano impatti giuridici rilevanti o che incidano su interessi personali, per arginare il rischio di “black box”, ovvero l’impossibilità di conoscere nel dettaglio tutti i passaggi che hanno condotto a una certa decisione. Qualsiasi decisione presa da terzi, ad esempio compagnie di assicurazione, datori di lavoro, enti pubblici sulla base di sistemi automatizzati, dovrebbe quindi sempre potere essere contestata.

Il diritto a non essere discriminati. La proposta impone obblighi di gestione dei dati per evitare bias discriminatori, sia diretti che indiretti. Gli sviluppatori e i provider di AI dovranno garantire che i sistemi non perpetuino o creino disuguaglianze.

Il diritto alla privacy e protezione dei dati deve essere garantito e pertanto viene imposto, come accade anche nell’AI Act, il rispetto delle leggi brasiliane sulla protezione dei dati personali.

Classificazione dei sistemi di AI

La proposta di legge brasiliana adotta un approccio basato sulla classificazione del rischio, suddividendo i sistemi di AI in due categorie principali, una a “rischio eccessivo” ed una ad “alto rischio”.

I sistemi che sono classificati a rischio eccessivo sono vietati per uso commerciale, data la loro capacità di minare la salute, la sicurezza o i diritti dei cittadini. Tra questi ci sono:

Sistemi che utilizzano tecniche subliminali per indurre comportamenti dannosi;

Sistemi che sfruttano vulnerabilità di gruppi specifici;

Sistemi utilizzati dalle autorità pubbliche per valutare il comportamento sociale dei cittadini, con conseguenze su accesso a beni e servizi.

In alcuni casi, come per i sistemi di identificazione biometrica per la sicurezza pubblica, è consentito l’uso a determinate condizioni, ad esempio con autorizzazione giudiziaria e solo per perseguire reati di una certa gravità.

I sistemi ad alto rischio sono, invece, quelli che hanno un impatto significativo su settori critici come:

Sicurezza delle infrastrutture;

Istruzione e formazione;

Reclutamento e decisioni lavorative;

Accesso ai beni pubblici e servizi d’emergenza;

Amministrazione della giustizia e veicoli autonomi.

Per questi sistemi, la proposta stabilisce obblighi più rigorosi, tra cui la necessità di documentazione, test di robustezza, gestione dei dati per prevenire bias e una supervisione umana, ma non sono vietati. Gli operatori devono però effettuare una valutazione d’impatto per identificare e mitigare i rischi potenziali.

Obblighi generali di governance e trasparenza

Oltre alla classificazione di rischio, la proposta impone una serie di obblighi generali per tutti i sistemi di AI, indipendentemente dalla loro categoria di rischio. Tali obblighi comprendono processi di sicurezza interna, per garantire la sicurezza dei sistemi e il rispetto dei diritti dei cittadini, massima trasparenza che si traduce nell’adozione di misure per rendere chiaro agli utenti l’uso dell’AI e le sue finalità.

La trasparenza è vista come un elemento fondamentale per costruire fiducia negli utenti, al pare del rispetto delle leggi sulla protezione dei dati. La gestione dei dati deve essere conforme alle normative brasiliane esistenti, assicurando che i sistemi non raccolgano o trattino dati in modo abusivo.

Responsabilità civile

Uno degli aspetti più innovativi della proposta è il sistema di responsabilità civile per danni causati dall’AI.

Il legislatore brasiliano prevede che i provider e gli operatori che utilizzano l’intelligenza artificiale siano tenuti a risarcire integralmente i danni economici, materiali e immateriali, prodotti, indipendentemente dal livello di autonomia del sistema.

In caso di sistemi ad alto rischio, la responsabilità del danno ricade sul provider solo se è dimostrato il suo coinvolgimento diretto e oggettivo nella causazione del danno stesso.

Questo approccio mira a creare un equilibrio tra responsabilizzazione degli sviluppatori e promozione dell’innovazione, riducendo il rischio di una responsabilità indiscriminata che potrebbe inibire l’adozione di nuove tecnologie.

Implicazioni e prospettive future

La proposta brasiliana, presentata nel maggio 2023 e ancora in fase di discussione presso la Casa Iniciadora, ovvero il Senato brasiliano, potrebbe rappresentare un modello normativo per l’America latina per giungere ad una regolamentazione armonizzata a livello globale.

Alcuni aspetti però richiedono maggiore chiarezza. Ad esempio, l’applicazione della supervisione umana potrebbe risultare difficile da implementare in contesti in cui l’automazione è predominante, mentre dovrebbero essere tenute in considerazione le implicazioni per le PMI, che spesso non dispongono delle risorse per rispettare pienamente gli obblighi previsti.

Il disegno di legge brasiliano si distingue per un’attenzione accentuata sul rispetto dei diritti umani e sul principio di proporzionalità. Questo potrebbe incentivare le aziende internazionali a sviluppare pratiche di AI etiche e trasparenti per potere entrare nel mercato brasiliano, contribuendo a una crescente standardizzazione normativa a livello internazionale. Il Brasile, comunque, sembra essere molto lungimirante in ambito AI e nella gestione delle tecnologie emergenti.

La proposta non solo protegge i cittadini da possibili abusi, ma promuove anche la fiducia nell’intelligenza artificiale, incentivando uno sviluppo tecnologico responsabile e sostenibile.

Guardando al futuro, sarà interessante osservare come questa normativa influenzerà lo sviluppo dell’intelligenza artificiale in Brasile e in America Latina, e se altri paesi seguiranno un modello simile, promuovendo un quadro regolatorio sempre più coeso a livello internazionale.

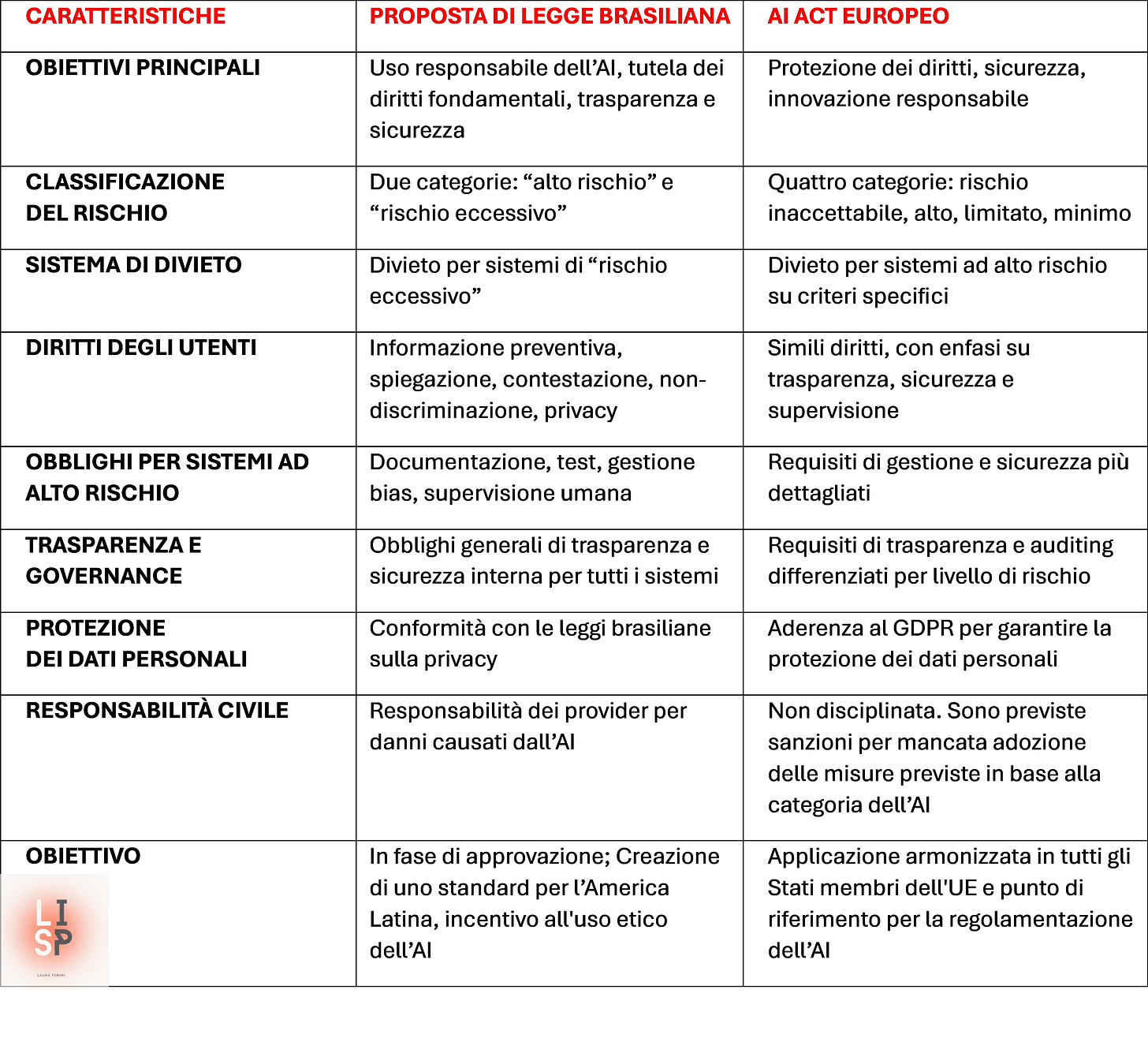

“Dispõe sobre o uso da Inteligência Artificial” e “AI act europeo” a confronto

La proposta di legge brasiliana n. 2338/2023 e l’AI Act europeo rappresentano tentativi significativi di regolamentare il settore dell’intelligenza artificiale, ciascuno con approcci specifici ma con obiettivi comuni, come la protezione dei diritti fondamentali, la trasparenza e la responsabilità civile.

La proposta brasiliana mira a stabilire diritti chiari per gli utenti e a classificare i sistemi di AI in base al rischio, imponendo restrizioni specifiche sui sistemi considerati “ad alto rischio” o “a rischio eccessivo”. L’AI Act europeo, a sua volta, stabilisce un quadro simile con un sistema di classificazione a più livelli e regolamenta obblighi e requisiti di trasparenza per promuovere un’AI etica e sicura.

Entrambe le normative riflettono un approccio precauzionale, ma differiscono nei dettagli delle disposizioni, nell'approccio alla responsabilità civile, che non viene affrontata nell’AI Act, e nei requisiti di conformità per i provider.

La tabella seguente fornisce un confronto tra i due testi normativi.

Grazie per aver letto LISP!

Nella rubrica Non Solo AI ACT analizzeremo e confronteremo i principali approcci che gli Stati stanno adottando per bilanciare i vari interessi in gioco: tutelare i diritti e incentivare l’innovazione.

Bella questa proposta, ha un approccio molto interessante!