#7_ AI ACT: Gli obblighi per i deployer di sistemi AI ad alto rischio

L'AI ACT prevede degli obblighi anche per i deployer, ossia gli utilizzatori di sistemi di intelligenza artificiale ad alto rischio. Vediamo quali sono.

Abbiamo visto gli obblighi specifici, dettati dall’AI Act, per i produttori di sistemi ad alto rischio e quelli per i distributori e gli importatori.

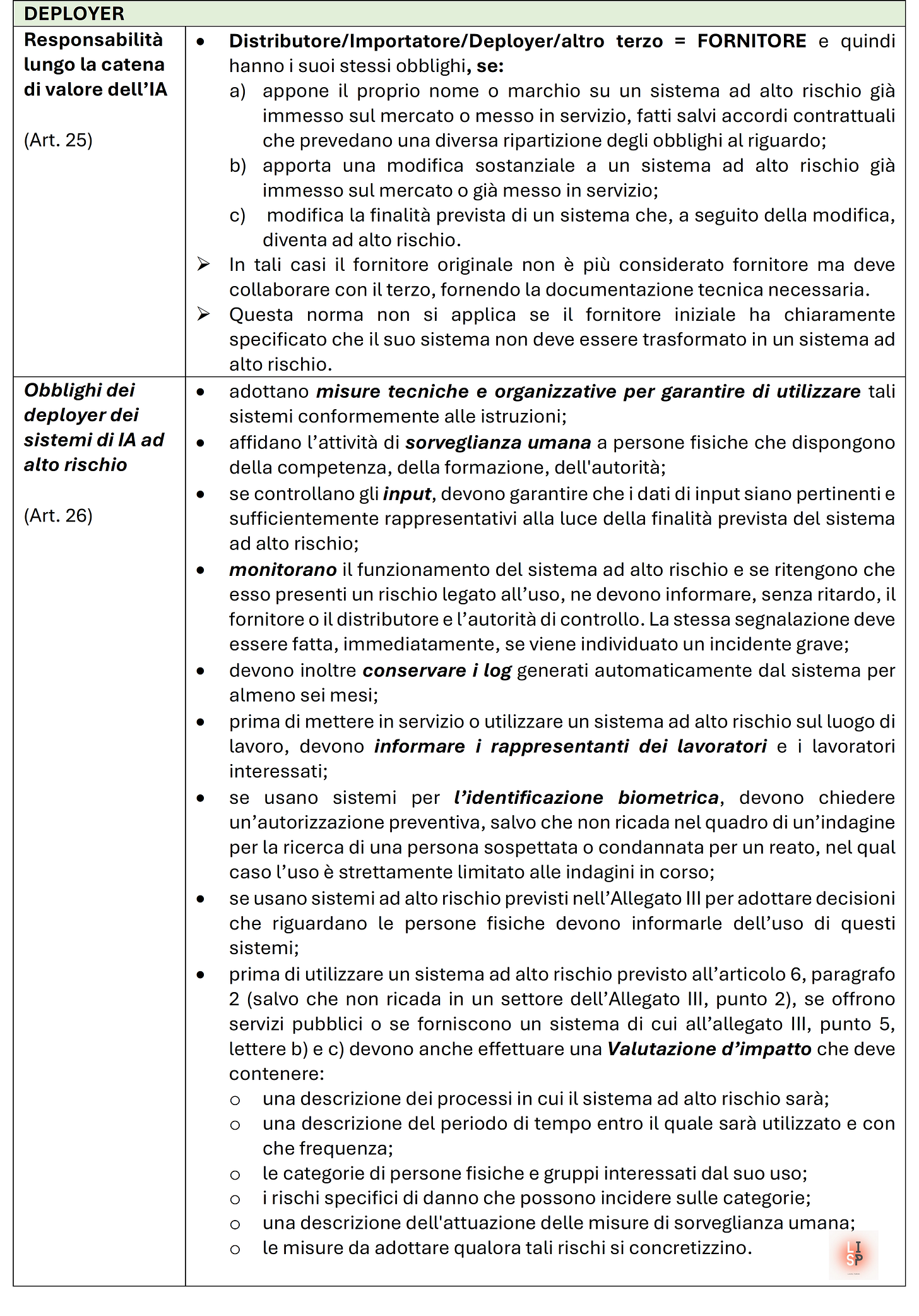

A queste categorie si aggiunge quella degli utilizzatori (deployer) e nel Regolamento c’è un importante articolo, l’art. 25, che si occupa della Responsabilità lungo la catena dell’intelligenza artificiale.

Responsabilità nella catena dell’intelligenza artificiale

L’art. 25 prevede che qualsiasi distributore, importatore, deployer o altro terzo è considerato un fornitore di un sistema di IA ad alto rischio, soggetto agli obblighi del fornitore a norma dell'articolo 16, se:

a) appone il proprio nome o marchio su un sistema ad alto rischio già immesso sul mercato o messo in servizio, fatti salvi accordi contrattuali che prevedano una diversa ripartizione degli obblighi al riguardo;

b) apporta una modifica sostanziale a un sistema ad alto rischio già immesso sul mercato o già messo in servizio;

c) modifica la finalità prevista di un sistema che, a seguito della modifica, diventa ad alto rischio.

Se si verifica una di queste condizioni, il fornitore iniziale non è più considerato fornitore ma deve comunque cooperare strettamente con il nuovo fornitore mettendo a disposizioni ogni informazione tecnica necessaria.

Questa norma non si applica se il fornitore iniziale ha chiaramente specificato che il suo sistema non deve essere trasformato in un sistema ad alto rischio.

Se il sistema ad alto rischio è un componente di sicurezza di uno dei prodotti che rientrano nell'allegato I, il fabbricante del prodotto è considerato il fornitore del sistema ed è soggetto agli obblighi di cui all'articolo 16, se il prodotto è immesso sul mercato insieme al prodotto che reca il marchio del fabbricante.

In tutti i casi in cui un fornitore fornisca a un terzo strumenti, servizi o componenti che vengono integrati in un sistema di intelligenza artificiale ad alto rischio, deve essere previsto un accordo scritto che preveda obblighi per il fornitore e gli consenta di adempiere a quanto previsto dal Regolamento. Questi accordi devono rispettare e tutelare i diritti di proprietà intellettuale e i segreti commerciali.

I deployer, ovvero gli utilizzatori dei sistemi di intelligenza artificiale ad alto rischio, devono adottare misure tecniche e organizzative per garantire di utilizzare tali sistemi conformemente alle istruzioni.

L’attività di sorveglianza umana deve essere affidata a persone fisiche che dispongono della competenza, della formazione, dell'autorità e del sostegno necessari allo scopo. Se controlla gli input, il deployer deve garantire che i dati di input siano pertinenti e sufficientemente rappresentativi alla luce della finalità prevista del sistema ad alto rischio.

I deployer monitorano il funzionamento del sistema ad alto rischio sulla base delle istruzioni di uso e se ritengono che esso presenti un rischio legato all’uso, ne devono informare, senza ritardo, il fornitore o il distributore e l’autorità di controllo. La stessa segnalazione deve essere fatta, immediatamente, se viene individuato un incidente grave.

Essi devono inoltre conservare i log generati automaticamente dal sistema per almeno sei mesi.

Prima di mettere in servizio o utilizzare un sistema ad alto rischio sul luogo di lavoro, i deployer devono informare i rappresentanti dei lavoratori e i lavoratori interessati.

Inoltre, se usano sistemi per l’identificazione biometrica, deve chiedere un’autorizzazione preventiva, salvo che non ricada nel quadro di un’indagine per la ricerca di una persona sospettata o condannata per un reato, nel qual caso l’uso è strettamente limitato alle indagini in corso.

Infatti, i sistemi ad alto rischio per l'identificazione biometrica remota a posteriori non possono mai essere utilizzati a fini di contrasto in modo non mirato, senza alcun collegamento con un reato, un procedimento penale, o una minaccia reale e attuale o reale.

Gli Stati membri possono introdurre anche disposizioni più restrittive sull'uso dei sistemi di identificazione biometrica remota a posteriori.

I deployer che usano sistemi ad alto rischio previsti nell’Allegato III per adottare decisioni che riguardano le persone fisiche devono informarle dell’uso di questi sistemi.

La valutazione d’impatto

I deployer, prima di utilizzare un sistema ad alto rischio previsto all’articolo 6, paragrafo 2 (salvo che non ricada in un settore dell’Allegato III, punto 2), se offrono servizi pubblici o se forniscono un sistema di cui all’allegato III, punto 5, lettere b) e c) devono anche effettuare una Valutazione d’impatto.

Questa valutazione deve contenere:

a) una descrizione dei processi in cui il sistema ad alto rischio sarà utilizzato;

b) una descrizione del periodo di tempo entro il quale sarà utilizzato e con che frequenza;

c) le categorie di persone fisiche e gruppi interessati dal suo uso;

d) i rischi specifici di danno che possono incidere sulle categorie;

e) una descrizione dell'attuazione delle misure di sorveglianza umana;

f) le misure da adottare qualora tali rischi si concretizzino.

Ecco una tabella che riepiloga gli obblighi per le varie categorie di soggetto.